打破视觉界限:3D相机如何精准识别物体的技术奥秘

随着人工智能和智能制造的发展,3D相机应运而生,成为许多高科技应用中的“慧眼”。那么,3D相机究竟是如何实现精准物体识别的?其背后的技术原理又有哪些突破?

从2D到3D:不仅仅是多了一个维度

与传统2D相机不同,3D相机能够获取物体的深度信息,从而生成具有三维坐标的点云数据。这种能力使得机器能够像人类一样感知物体的立体形状、位置姿态甚至表面材质。无论是在工业分拣、自动驾驶、人脸识别,还是在AR/VR领域中,3D相机都展现出了强大的应用潜力。

目前,实现3D视觉的技术方案主要分为三类:结构光技术、双目视觉技术和飞行时间法(ToF)。每种技术各有优劣,适用于不同场景。

-

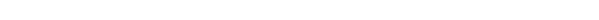

结构光技术

结构光技术通过投射特定的光斑或条纹图案到物体表面,再通过相机捕捉因物体高度变化而产生的图案形变。通过解算形变信息,系统可以计算出物体的深度数据。这种方案精度高,适合静态场景下的高精度测量,广泛应用于工业检测和三维扫描。 -

双目视觉技术

双目视觉模仿人类双眼的视差原理,通过两个摄像头从不同角度拍摄同一物体,再通过算法匹配两幅图像中的对应点,计算出深度信息。这种方案环境适应性较强,但在缺乏纹理的区域匹配难度较大。 -

飞行时间法(ToF)

ToF技术通过计算光线从发射到返回的时间差来获取深度信息。它能够实时生成深度图像,适用于动态场景,例如自动驾驶中的障碍物检测和机器人导航。不过,其精度容易受到环境光和反射面的影响。

从三维数据到物体识别

获取点云数据只是第一步,如何从中识别出特定物体才是技术的关键。现代3D视觉系统通常结合多种算法实现这一目标:

- 点云处理:通过滤波、分割和聚类等方法,将原始点云处理成具有不同特征的区域,排除噪声干扰并提取潜在目标物体。

- 特征提取与匹配:基于点、线、面等几何特征,或通过深度学习网络提取更高级的语义特征,与模型库中的物体特征进行匹配。

- 位姿估计:进一步计算物体在空间中的位置和旋转角度,为机械臂抓取、自动驾驶决策等应用提供依据。

近年来,随着深度学习的发展,许多基于神经网络的3D物体检测算法(如PointNet、VoxelNet等)大幅提高了识别精度和速度。这些算法能够直接处理点云数据,实现对复杂场景中多类别物体的实时识别。

应用场景:精准识别改变世界

3D相机的精准物体识别能力已经在多个领域展现出巨大价值:

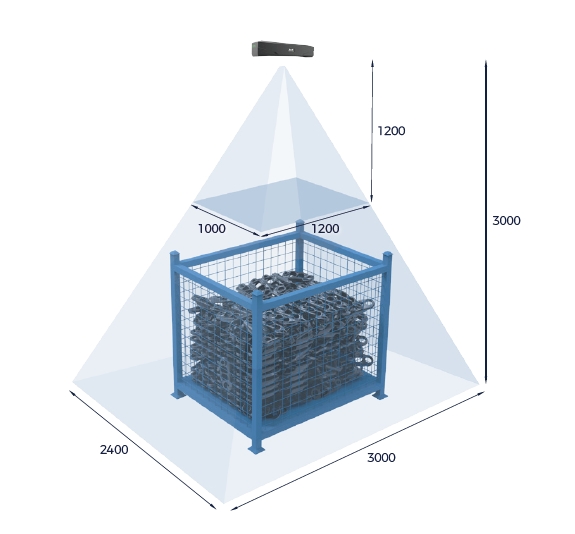

- 工业自动化:在流水线上,3D视觉系统能够准确识别零件的位置和型号,引导机械臂完成分拣、装配等操作,大幅提高生产的灵活性和效率。

- 物流与仓储:通过3D相机识别包裹的形状和体积,实现自动化分拣和仓储管理,降低人工成本并提升物流效率。

- 自动驾驶:车辆依靠3D视觉感知周围环境,识别行人、车辆、障碍物等,为决策系统提供可靠的数据输入。

- 生物识别与医疗:3D人脸识别技术比2D更具防伪能力,已广泛应用于支付、门禁等场景。在医疗领域,3D相机辅助手术导航、假肢定制等应用也日益成熟。

未来展望

尽管3D相机技术已经取得显著进展,但仍面临一些挑战,比如在强光、暗光等极端环境下的稳定性、复杂物体之间的遮挡问题以及计算效率的优化。未来,随着传感器技术的进步和算法的不断创新,3D相机的性能将进一步增强,成本也逐渐降低。它与5G、边缘计算、人工智能等技术的融合,必将为更多行业带来革命性的变化。

从平面到立体,从“看见”到“识别”,3D相机正以一种深刻的方式改变机器与世界的交互模式。而这双“智慧之眼”的背后,是多项尖端技术的交融与迭代,也为未来的科技创新提供了无限可能。

致瑞新闻

致瑞新闻